日立が面白いカメラ技術を開発した。恐らく、この分野では最も先進的な方式になる。この技術を使えば、3D動画撮影が可能になる。発表は11月15日だったが、原理を理解するのに時間がかかってしまった。

動画撮影後に容易にピント調整ができるレンズレスカメラ技術を開発 2016.11.15

http://www.hitachi.co.jp/New/cnews/month/2016/11/1115.html

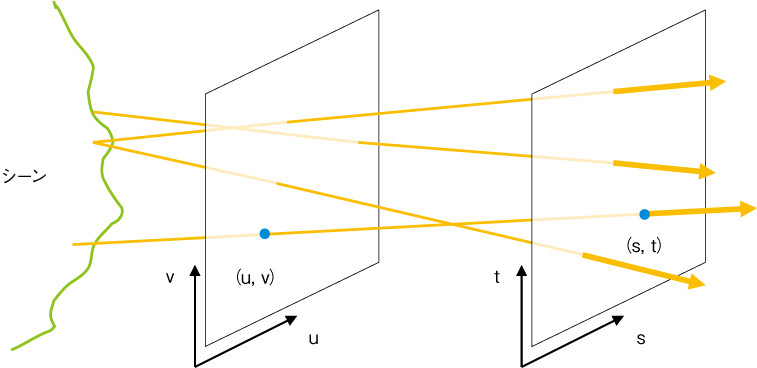

その前に光場カメラ(ライトフィールドカメラ)とはなんぞやという事になるのだが、有名なものではLytroのカメラやiPhone7 Plusに搭載されたデュアルレンズ方式による。後でピント合わせが出来る画像センサーだ。これによってボケが再現できるとあるのだが、この方式のデータを画像処理すると、奥行き情報が得られ、3D写真を撮れるのである。だが、この方式の弱点は画像処理に時間がかかる事で、Appleの製品でも静止画止まりで動画は撮影できていない。しかし、日立が開発した方式は、従来のものよりも300倍高速に処理できると言うもので、動画撮影も十分できると言うものなのだ。なぜそんな事が出来るかと言うと、通常のセンサーは、光を点で感知する。しかし、光場センサーは光の方向性を感知する。いわば点だけでなく線(光がどの方向からきたか)も感知できるのである。

これによって、光がどちらの方向から来たかがわかり、このデータを演算すると、焦点距離を可変することができ、その結果、撮影した後でもピント合わせが出来たりするのである。しかし、従来の、この種のカメラ技術には欠点があって、焦点情報の解像度が低くて、不自然なボケになってしまったり、演算処理に時間がかかり動画撮影は出来なかったり、Appleの方式では、焦点距離の違うレンズを使っているので画角が狭いレンズに撮影範囲が制限されるなどの欠点がある。ファーウェイのデュアルレンズは、この問題を専用のモノクロの高解像度なセンサー(モノクロにする事で3倍の解像度)とする事で、高品位なボケを再現しており、市場に出ている製品の中では最も優れていたりするが、演算処理が重いので動画撮影までは出来ていない。

ライカ ダブルレンズ搭載スマホHUAWEI P9の圧倒的なカメラ

http://japanese.engadget.com/promo/huawei_p9/

HUAWEI P9の高品位なボケのサンプル

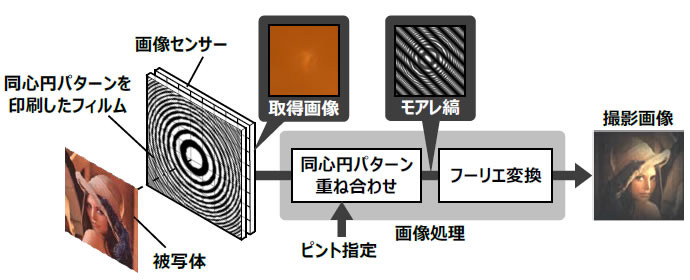

このように、後でピント処理が(焦点距離を変更)出来るカメラが既にある。このデータを演算すると奥行き情報が得られ、そこから視差を合成し、3D映像が得られるのである。ただ、処理負荷が非常に大きいので、現行のスマホは焦点距離を可変する機能はあっても、3Dカメラにはなっていない。日立の今回のカメラ技術の優れている点は、この負荷をJPEG圧縮でも使っているフーリエ変換処理で実現している点。(フーリエ級数展開:どんな関数でも、三角関数の足し算だけで置き換えられる)

これにより、従来の300倍の速度で奥行き情報を生成できるとの事。原理としては、ホログラフィックを用いているようだ。

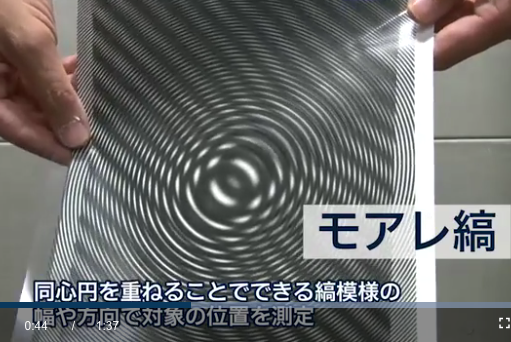

仕組みとしては、レンズではなく同心円のパターンのフィルムを通した光の影(モアレ:干渉稿)をフーリエ変換して画像を抽出する。

日経:日立の映像デモ

http://www.nikkei.com/video/5210860964001/

この処理の過程で奥行き情報を取得できる。奥行き情報がどのようにわかるかというと、光が入射する角度によって、同心円パターンを光が透過する時にできる影がモアレとなって現れる。これをフーリエ変換で周波数分解をして抽出。実映像と光の入射角を得る。これらの情報を用いて奥行き情報を得る。特筆すべきはこれらの処理が従来の1/300の計算負荷で出来、一般的なノートPCで30フレームの動画撮影が出来る事。しかもレンズを使わないので薄く、低コストに出来る。日立では2018年に実用化したいとの事。

このカメラは、レンズを使わないので薄く、そして、3D映像が動画で得られる事。つまり、スマホで3D動画が撮影できるのだ。ただ、影を用いる方式なので、感度がどの程度なのかと言う事と、奥行き情報の解像度がどの程度のものになるのかわからない。案外、普通のカメラで通常の映像を得て、奥行き情報は、このカメラ技術で得るという形になるのかもしれない。そうであったとしても、処理負荷が1/300なので、このデータを用いてスマホで3D映像が得られるというのはスゴイ。一気に3Dカメラが実用化する気配だ。3D画像データはJPEG PLENO規格で記録されるだろう。動画はJPEG XSが採用されると思う。JPEG XSは、恐らく、このカメラ技術に合わせて拡張され、3D Motion JPEGみたいな規格になるかもしれない。

これから、モノを写す時に商品をくるくる回して撮影したり、回り込んで撮影する事で立体スキャンするような撮影が行われるかもしれない。また、自分の立体写真を撮っておけば、AIがその立体データに合った衣類や靴を選び出し、最適なコーディネートを提案するみたいなサービスが出来るかもしれない。ともあれ、面白いカメラ技術だ。ぜひ実用化して欲しい。立体映像を見る方法は、ゴーグルにスマホを入れる方式を使えば、比較的、低コストな3D動画ディスプレイで見れるだろう。GoogleのDaydream View(79ドル)みたいな奴を使ってフルHDのスマホを入れて見ればいい。つまり、この3Dカメラ技術を持ったフルHDのスマホと、それを装着して立体視を実現するヘッドマウントアダプタ(79ドル程度)を購入すれば、比較的、簡単に3D映像の撮影と視聴が可能となるわけだ。2018年が楽しみ。

3D動画撮影:3Dカメラスマホ+ヘッドマウントユニット(79ドル)

引用元:Google’s “Daydream View” VR headset is smartphone-powered VR for $79 | Ars Technica